Ein Konzern gegen alle

Nvidia kontrolliert das Betriebssystem der KI-Industrie: Mit einem Marktanteil von rund 90 Prozent bei Trainingsprozessen für neuronale Netze und Margen von bis zu 73 Prozent kassiert der Chipriese ab, während Microsoft, Amazon, Meta und Google die Rechenarbeit erledigen.

Doch hinter den Kulissen rühst Big Tech zum Gegenangriff: Statt weiter Milliarden für Nvidias Blackwell- und Hopper-Chips zu zahlen, bauen die US-Giganten jetzt an eigenen Systemen.

Im Visier: der Zukunftsmarkt der Inferenz-Rechenzentren, in dem Effizienz wichtiger ist als rohe Leistung.

Microsofts Angriff aus Redmond

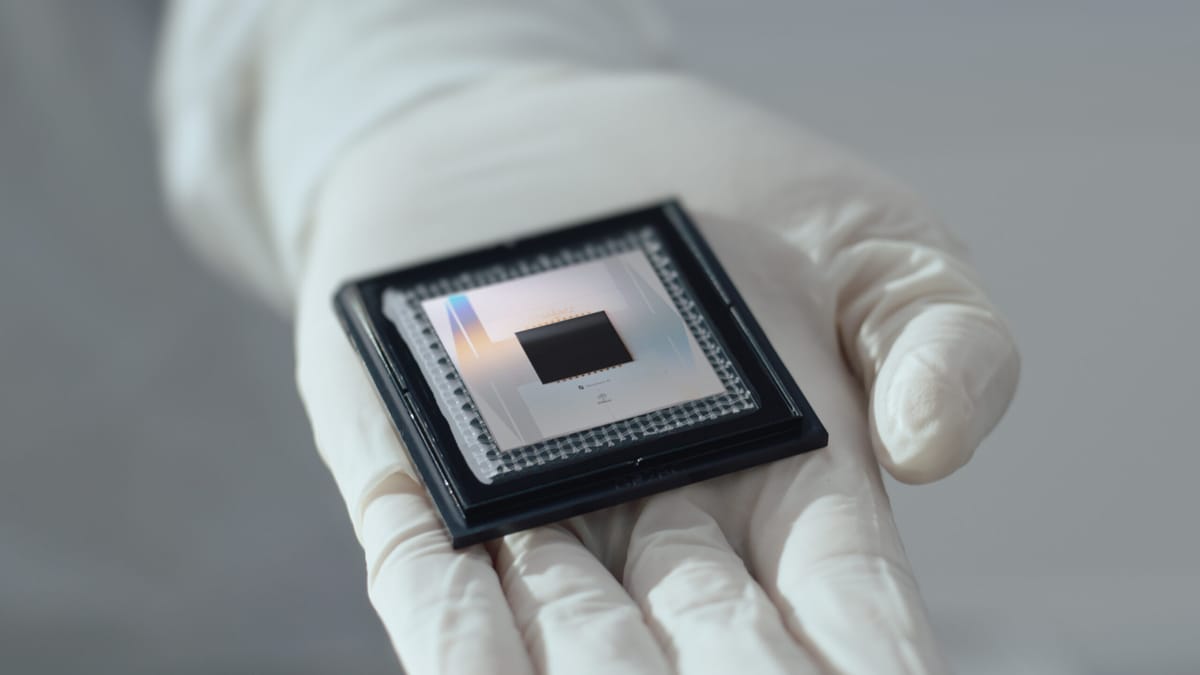

In einem Hochsicherheitslabor auf dem Microsoft-Campus in Redmond entsteht der vielleicht aggressivste Frontalangriff auf Nvidia: Mit den neuen "Maia 100"-Beschleunigern, eigener CPU namens "Cobalt" und einer komplett proprietären Wasserkühlung geht der Konzern den Weg der radikalen vertikalen Integration. Alles optimiert für Azure-Rechenzentren.

Die Chips, gefertigt bei TSMC, sollen künftig das Rückgrat der Microsoft-Infrastruktur bilden und die Nvidia-Abhängigkeit drastisch senken.

Amazon, Google, Meta ziehen nach

Amazon hat mit "Trainium" und "Inferentia" bereits eigene KI-Prozessoren im Einsatz, die bei Alexa-Berechnungen 30 Prozent günstiger und 25 Prozent schneller arbeiten als Nvidia-Alternativen.

Google stellte im April die siebte Generation seines TPU-Chips vor, der doppelt so effizient rechnet wie der Vorgänger. Und auch Meta bastelt an einem eigenen KI-Beschleuniger. Gemeinsames Ziel: Nvidia aus dem Spiel nehmen.

Ein Machtkampf mit offenem Ausgang

Noch liefert Nvidia das Beste, was der Markt zu bieten hat. Doch die Entwicklung verlagert sich: Während die Trainingseinheiten großer KI-Modelle weiter auf Nvidias GPUs laufen, sollen eigene Chips die Inferenz – das Ausführen der Modelle im Echtbetrieb – billiger, effizienter und unabhängiger machen.

Inferenz ist das neue Schlachtfeld. Wer hier mit eigener Hardware skalieren kann, kontrolliert die Marge.

TSMC wird zum heimlichen Machtzentrum

Ob Nvidia, Microsoft oder Google – alle lassen bei TSMC fertigen. Der taiwanische Auftragsfertiger ist der wahre Gewinner des KI-Booms: Seine Kapazitäten sind auf Jahre ausgebucht. Nvidia-CEO Jensen Huang weiß das, und riet TSMC im Sommer offen zu Preiserhöhungen.

Ein strategischer Schachzug: Während Nvidia hohe Margen weitergeben könnte, würden Microsoft & Co. die neuen Preise deutlich stärker zu spüren bekommen.

Wie stabil ist Nvidias Zukunft?

Die aktuelle Chipgeneration "Blackwell" ist ausverkauft, die Nachfrage enorm, die Prognosen optimistisch. Doch die Konkurrenz investiert zweistellig in Milliardenhöhe in eigene Hardware. Sollte es den Techriesen gelingen, Inferenz und später auch Training effizienter und unabhängiger abzubilden, könnte Nvidias Gewinnmaschine deutlich an Fahrt verlieren.

Noch hat Nvidia den technologischen Vorsprung. Doch wer seine besten Kunden zu Konkurrenten macht, spielt ein Spiel, das schnell kippen kann.

Das könnte Sie auch interessieren: